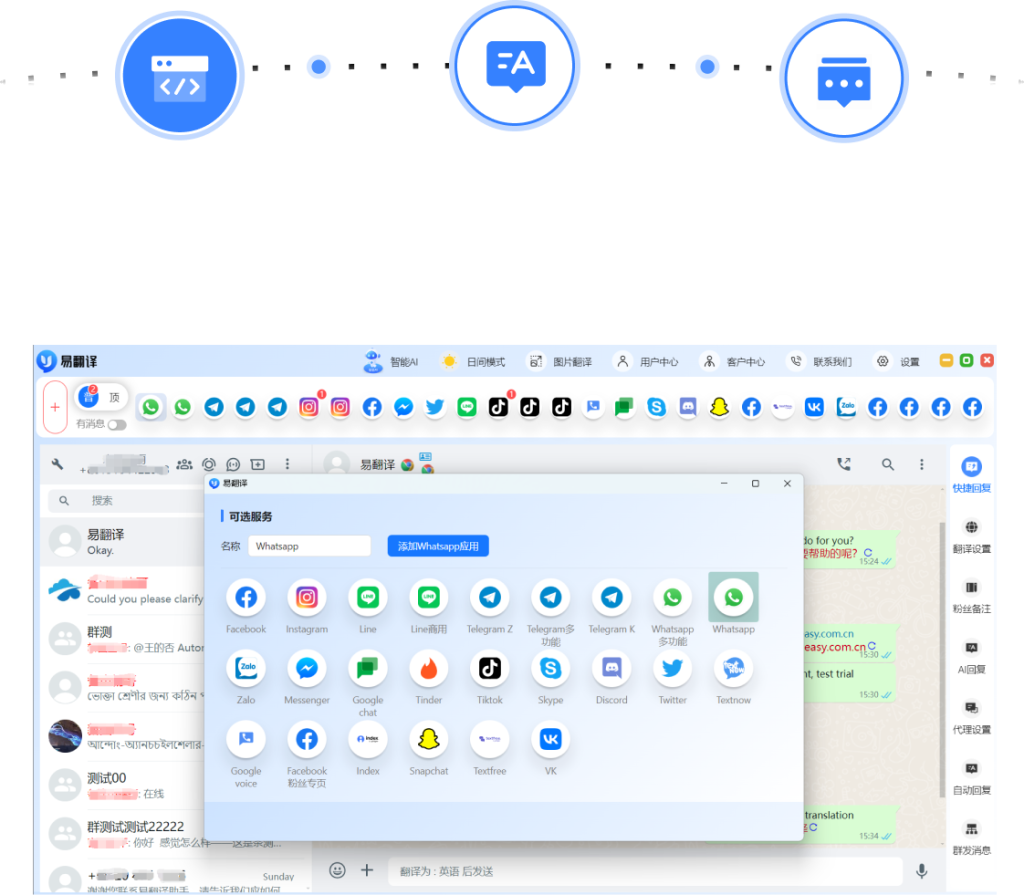

易翻译开发者接口调用总体步骤:在开发者平台注册并获取API Key,阅读文档选择合适端点(文本/语音/拍照/对话),用HTTPS或WebSocket发起请求,带上认证头和语言参数,上传文本、音频或图片,解析返回的JSON,处理错误与重试,做好音频编码和图片OCR前处理,使用缓存与限流保护最后展示。

先把“怎么用”拆成几步来理解

像费曼那样:如果我要把调用过程讲给一个从未接触过API的朋友,我会分三步来说明——准备、请求、处理结果。把每步讲清楚,细节就不会迷路。

准备阶段:账号、密钥、权限

- 注册开发者账号:在易翻译的开发者平台上注册并完成实名认证(如果有要求)。

- 申请或生成API Key/Secret:常见是获得一个API Key(公钥)和Secret(私钥),用于后续鉴权。多数平台在“控制台”里能看到。

- 测试环境与配额:先在沙箱或测试环境跑,注意每个账号的免费次数或速率限制(quota/rate limits)。

- 阅读文档与权限配置:确认你需要的接口(文本翻译、实时语音、拍照取词、双语对话)是否在当前权限范围内。

请求阶段:端点与调用方式一览

不同场景用不同的调用通道:

- 文本翻译:HTTP(S) REST API,POST JSON,适合短文本、批量翻译。

- 语音实时互译:WebSocket 或 gRPC 流式传输,适合实时通话、双语对话。

- 拍照取词(OCR):HTTP 上传图片(multipart/form-data 或 base64 JSON),先做OCR再翻译。

- 双语对话:通常由服务端提供会话ID,结合语音识别、翻译和语音合成的流水线。

标准请求示例(最容易上手)

先看最常见的文本翻译:一个HTTPS POST 请求,带上认证头和JSON正文。

curl 示例(文本翻译)

curl -X POST "https://api.yifanyi.example.com/v1/text/translate" \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"source_language": "zh",

"target_language": "en",

"text": "今天天气很好"

}'

常见返回(JSON):

{

"request_id": "abc-123",

"source_language": "zh",

"target_language": "en",

"translated_text": "The weather is great today.",

"confidence": 0.98

}

Python requests 示例

import requests

url = "https://api.yifanyi.example.com/v1/text/translate"

headers = {"Authorization": "Bearer YOUR_API_KEY", "Content-Type": "application/json"}

payload = {"source_language":"zh", "target_language":"en", "text":"我想去北京"}

resp = requests.post(url, json=payload, headers=headers)

print(resp.json())

实时语音/对话:用WebSocket分片上传音频

实时场景不能等到整段音频上传完才翻译,所以常用WebSocket做双向流通信。思路是:先建立连接,发送“会话开始”消息(携带语言对、采样率、编码格式),然后分片发送音频帧(通常base64或二进制),最后发送“结束”消息,服务端逐片返回识别结果与翻译。

WebSocket 样例消息流程(伪格式)

- 客户端 -> 服务端:{“type”:”start”,”source”:”zh”,”target”:”en”,”sample_rate”:16000,”format”:”pcm16″}

- 客户端 -> 服务端:二进制音频帧(或{“type”:”audio”,”data”:”base64…”})

- 服务端 -> 客户端:{“type”:”partial”,”transcript”:”你好”,”translation”:”Hello”}(中间结果)

- 客户端 -> 服务端:{“type”:”end”}

- 服务端 -> 客户端:{“type”:”final”,”transcript”:”你好,欢迎”,”translation”:”Hello, welcome”,”is_final”:true}

注意音频的采样率、声道数、编码(PCM16/Opus)要与服务端约定一致。

拍照取词(OCR + 翻译)

拍照翻译通常是两步:先OCR识别文字区域,再把识别出的文字发去翻译端点。很多平台把两步合并为一个接口,开发者只需要上传图片。

图片调用要点

- 支持格式:jpg/png/webp 等;注意尺寸与文件大小限制。

- 传输方式:multipart/form-data(推荐)或 base64 字符串。

- 预处理:自动旋转、裁剪、降低噪声可以提升识别率。

常见请求参数与返回字段(快速参考表)

| 端点 | 常用参数 | 主要返回 |

| /v1/text/translate | source_language, target_language, text, format | translated_text, confidence, request_id |

| /v1/speech/stream | 会话控制消息: start/chunk/end, sample_rate, encoding | partial/final transcripts, translations, timestamps |

| /v1/image/ocr_translate | image (multipart/base64), region, source_language, target_language | recognized_text, translated_text, boxes |

| /v1/dialog/session | session_id, user_id, context, audio/turn messages | turn translations, suggested replies, session_state |

错误码与重试策略

API调用过程中会遇到各种错误,按类型处理更稳妥:

- 客户端错误(4xx):参数错误、认证失败。遇到这类错误应立即停止并打印日志,修正后再试。

- 服务端错误(5xx):短期重试可行(指数退避),并做好幂等控制。

- 网络超时/连接中断:WebSocket重连,短语音段可做断点续传或重新发送最近几帧。

| 状态码 | 含义 |

| 400 | 请求格式错误或缺少必要参数 |

| 401 | 认证失败(API Key无效或过期) |

| 403 | 无权限访问该资源 |

| 429 | 请求过多,触发速率限制 |

| 500 | 服务器内部错误,建议重试 |

实战中的细节和坑(这些能省你很多时间)

- 鉴权方式:多数产品支持

Authorization: Bearer <API_KEY>,也有基于签名的短时Token(先用Key/Secret换取短期Token),后者更安全。 - 跨域与浏览器限制:如果直接在浏览器前端调用API,注意CORS策略和把敏感Key放在前端带来的风险。推荐后端代理或短期签发Token。

- 音频编码匹配:手机录音默认可能是16k/48k、stereo/mono,要确保服务端支持并按需下采样或转码(Opus在带宽受限时优先)。

- 图片质量:OCR敏感于模糊、光照、倾斜。对旅行场景照相做自动裁剪与增强,能显著提升识别率。

- 并发与限流:在高并发场景下对调用做队列和令牌桶限流,防止瞬时峰值被拒绝。

- 缓存和去重:对重复相同文本做本地缓存,能减少API调用成本并提升响应速度。

- 日志与链路追踪:记录request_id、latency、错误堆栈,便于定位问题。

示例:整合流程(文本 + 语音 + 图片)

假设一个旅行助手场景,用户可以键入、拍照或语音输入,服务端负责统一调用易翻译:

- 用户拍照 → 客户端发送图片到后端 → 后端调用 /v1/image/ocr_translate → 返回识别文本与译文 → 客户端高亮显示。

- 用户语音对话 → 客户端通过WebSocket发送音频帧 → 服务端推送识别与翻译片段 → 客户端实时显示并可选择播放合成语音。

- 用户输入文本 → 后端直接调用文本翻译端点,结果快速回显。

调试技巧(小方法大作用)

- 用curl先复现一次请求,把返回JSON贴到日志里,确认字段含义。

- 对WebSocket使用Wireshark或浏览器Network面板观察消息交互(注意敏感信息)。

- 在正式环境前做压力测试,找出限流点和响应延迟的瓶颈。

- 当语音识别结果差时,回看采样率、通道数、噪声等;OCR结果差多半是光照或分辨率问题。

安全与合规

存储或转发用户语音、图片、对话内容需要合规:隐私政策、用户授权、敏感信息脱敏(如身份证号)等。短期Token、HTTPS/TLS和最小权限原则是必须的。

SDK 与集成建议

很多平台会提供官方SDK(Java/Node/Python/iOS/Android)。优先采用官方SDK能省去重复实现鉴权、重试、断线重连等逻辑。如果没有官方SDK,封装一层内部SDK,把认证、重试、日志统一处理。

常见API设计样式

- 同步REST:适合文本,响应即为翻译结果。

- 异步任务:适合长文本或批量任务,先提交任务得到task_id,再轮询或通过回调获取结果。

- 双向流:适合实时语音,低延迟返回中间结果。

最后,几个落地的小建议

- 先把最简单的文本接口接上,确保认证和基本逻辑无误;

- 再做语音的PoC,优先用短语音段测试WebSocket握手与帧格式;

- 把OCR当成独立模块来调优,裁剪与增强比更换模型更有效;

- 建立统一的错误码映射表,方便前端显示用户友好信息;

- 上线后继续监控:延迟、错误率、费用、用户反馈。

好啦,说到这儿,我自己也觉得如果立刻动手做个Demo,从文本开始,然后加上语音和拍照,半天之内就能把易翻译的主要功能跑通——有些细节会在实践中暴露出来,到时候再调整就行。