要删除易翻译里的冗余,先明确你指的是哪类冗余(历史记录、词库条目、缓存、重复翻译或界面功能),然后按类别采用清理、合并、规范化或后台去重策略;在操作前做好备份与隐私确认,必要时使用模糊匹配与语义聚类来智能合并,最后检查效果并保留版本恢复点。用户可在设置里手动或批量删除,开发者应有回收站以防误删更稳妥。

先把问题说清楚:什么是“冗余”

冗余并不是一个固定概念,在翻译工具里它通常指重复或多余的信息——可以是历史记录里重复的翻译条目、词库(或收藏、短语本)中的重复条目、缓存与临时文件的堆积,甚至是界面上不必要的功能入口。把概念讲清楚很重要,因为不同类型的冗余需要不同的处理方法。

易翻译中常见的冗余类型

历史记录与最近翻译

这是用户最直观看到的冗余:同一句话多次翻译后,历史里出现很多近乎相同的记录。长时间积累会占用界面资源和存储空间。

词库/收藏/短语本冗余

用户会把相似或完全相同的词条收藏多次,或者不同用户导入同一词库时产生重复条目。词条往往有不同的大小写、标点或细微变体,单纯的精确匹配无法完全去重。

缓存与临时文件

包括离线包、语音临时文件、模型缓存等。它们不是“信息重复”,但长期不清理会被误认为冗余并影响存储与性能。

重复语音/录音

同一段语音多次录入或识别结果被保存为多个音频/文本对象。

翻译结果里的语言层面冗余

翻译输出中可能包含多余的注释、重复短语(尤其在机器翻译启用了多条候选或增强解释时),这类冗余影响可读性。

用户层面:如何一步步删除冗余(实操)

- 明确目标:先判断要清理的是历史、收藏、缓存还是离线数据。

- 备份数据:导出词库或同步到账号(如果支持),避免误删后无法恢复。

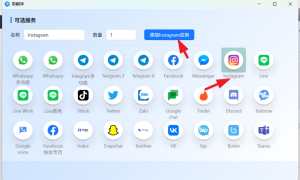

- 手动删除:在“历史”或“收藏/短语本”界面,通常支持单条删除或多选批量删除。选好时间范围或关键词进行筛选再删除更安全。

- 批量清理:设置里一般会有“清除缓存”“清空历史”“卸载离线包”的选项,按需使用。

- 使用回收站/撤销:若应用提供回收站,先把删除的条目放入回收站并保留一段时间再彻底删除。

- 离线包与下载管理:删除不常用的语言包或语音包,节省空间并减少“冗余资源”。

- 账户同步检查:如果多个设备同步,要在云端或其它设备也同步删除,防止重复再出现。

具体操作举例(用户端)

比如要去掉词库中重复的“thank you”:在词库页面搜索“thank you”,按日期或最近使用排序,勾选多个重复项选择“合并”或“删除”。没有合并功能时,先导出词库为 CSV,离线在表格软件里去重后再导入回去。

开发者视角:如何在体系上消除冗余(技术要点)

这里稍微深入一点,把问题拆成两步:检测(找出重复)和合并/删除(处理重复)。

第一步:归一化(Normalization)

- 小写化(lowercasing)

- 去除多余空格、统一标点(normalize punctuation)

- 简繁/大小写/全角半角统一

- 对语音:去除静音段、标准化采样率

归一化是后续任何匹配算法的前提,它能把表面差异消除掉,避免“Thank you”和“thank you ”被识别为不同条目。

第二步:精确匹配与哈希

对归一化后的文本做哈希(比如MD5/sha1),可以快速发现完全相同的条目,适合用于实时过滤与唯一约束。

第三步:模糊匹配(Fuzzy Matching)

适用于拼写差异、词序差异等。常用方法包括编辑距离(Levenshtein)、n-gram Jaccard、归一化的相似度阈值检测。对短语本、词条去重时常用。

第四步:语义去重(Semantic Deduplication)

当两条内容表面差异较大但意义接近(如同义句)时,需要语义层面的判断。现代做法包括把句子转成向量(如使用句向量/嵌入),然后用余弦相似度或聚类算法检测近义组。

第五步:合并策略与冲突解决

去重不是简单删除——通常需要合并元数据(来源、时间、标签、使用频率)。建议采用“软合并”策略:生成一个主记录并保留副本可回滚,或使用回收站机制。

第六步:性能与工程化

- 大规模场景用倒排索引或近似最近邻(ANN)加速语义相似度检索。

- 后台批处理 vs 实时检测:对历史数据做周期性批处理,对新增条目做实时检测。

- 保留审计日志与版本号,支持恢复与用户申诉。

对比表:常见去重方法一览

| 方法 | 优点 | 缺点 | 适用场景 |

| 精确匹配(哈希) | 速度快、简单可靠 | 不能处理表面差异 | 完全重复条目、实时过滤 |

| 编辑距离 / 模糊匹配 | 可处理拼写与小改动 | 参数敏感,误判可能性较高 | 短文本、词条去重 |

| 语义向量(Embedding) | 可识别近义句与语义重复 | 计算资源大、需阈值调优 | 长句、句子级去重、智能合并 |

| 人工审核+规则 | 准确率高,业务可控 | 成本高、耗时 | 关键数据、敏感合并操作 |

实际演练:合并重复词条的工作流(开发+产品)

一步步来,想象有成千上万个用户导入词库,产生大量重复条目:

- 收集:先把需要处理的数据抽样,统计重复率与重复模式(完全重复、拼写差、同义句)。

- 规则设计:对高频模式先用规则处理(如标点与大小写),降低数据规模。

- 算法优选:规则降噪后用模糊匹配合并低复杂度重复,再对剩余用语义模型做聚类。

- 合并策略:定义主记录选择策略(最新使用、收藏数高或管理员标记),合并时保留来源信息。

- 回滚与人工审核:对自动合并结果做抽样审核,重要条目进入人工复核流程。

- 上线监控:观察误合并率、用户投诉与存储节省效果,迭代阈值。

常见问题与注意事项(别忽视这些)

- 误删风险:尤其是相似但有细微差别的术语(专有名词、地名、代码片段)。

- 语言多样性:不同语系(如中英混写、日文假名)需要特殊归一化策略。

- 隐私合规:清理历史前考虑用户隐私与法规要求(例如是否需要保留审计记录)。

- 离线数据:用户设备上的缓存和离线包清理会影响离线体验,需提示并征得确认。

- 用户可控性:给用户撤销或回收站选项,会显著降低误删造成的阻力。

小技巧:让清理更省心

- 定期自动清理:提供自动删除不常用历史(例如90天未用)的选项。

- 智能合并建议:在用户编辑词条时给出合并建议,而不是强制合并。

- 导出-清理-导入:支持导出词库CSV,用户离线做去重后再导入。

- 清晰的回收机制:删除后保留30天回收期,以防误删。

写到这里,忽然想到一条比较现实的经验:很多冗余产生是因为用户怕误删而重复保存,所以在设计上多一点温柔(提示、回收站、自动备份)会比强力去重更能获得用户信任。要是你现在就在看词库,先别急着全删,导出一份做个备份,慢慢合并,会更安心。